O que é MCP e por que ele importa para o futuro dos agentes de IA?

Se você acompanha o ecossistema de inteligência artificial nos últimos anos, provavelmente já se deparou com termos como agentes de IA, function calling, RAG e ferramentas externas. Mas existe um protocolo que está silenciosamente se tornando a espinha dorsal de como os modelos de linguagem se comunicam com o mundo real: o MCP — Model Context Protocol.

Neste post, vamos entender o que é o MCP, por que ele foi criado, qual problema ele resolve e por que você, desenvolvedor, deveria prestar atenção nele agora.

O problema que o MCP resolve

Imagine que você quer construir um agente de IA capaz de:

- Consultar um banco de dados

- Ler arquivos do seu sistema

- Chamar uma API externa

- Executar código

Antes do MCP, cada integração era feita de forma ad hoc. Cada LLM tinha sua própria forma de lidar com ferramentas externas. O OpenAI tinha o function calling, o LangChain tinha seus tools, o LlamaIndex tinha seus query engines… e assim por diante.

O resultado? Fragmentação total. Uma ferramenta construída para funcionar com GPT-4 não funcionava nativamente com Claude. Um servidor de contexto construído para LangChain não era reaproveitável em outro framework.

Era como se cada fabricante de eletrônicos usasse um tipo diferente de tomada — e você precisasse de um adaptador diferente para cada aparelho.

O que é o MCP?

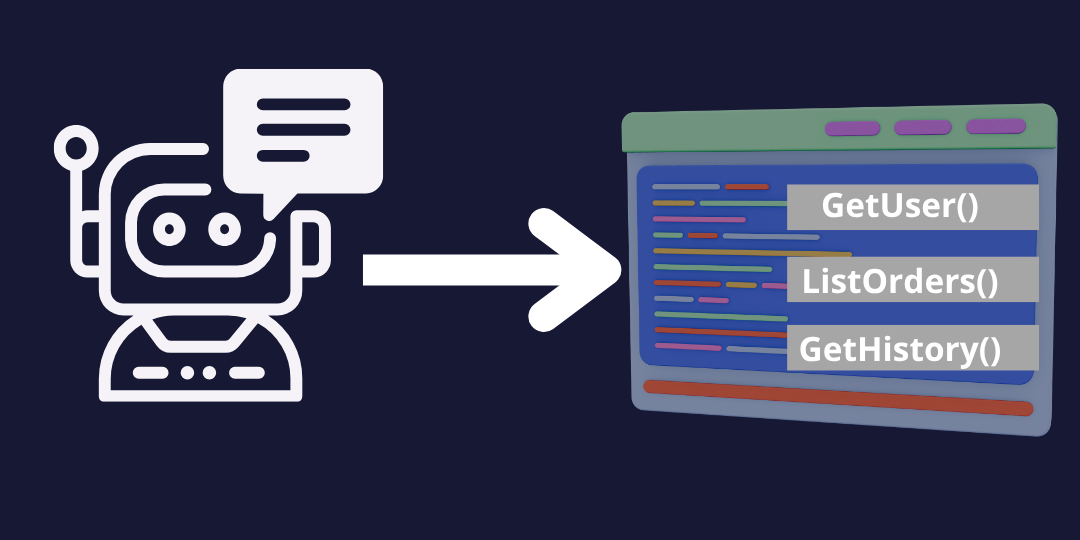

O Model Context Protocol é um protocolo aberto, criado pela Anthropic e lançado em novembro de 2024, que define uma forma padronizada de conectar modelos de linguagem a fontes de dados e ferramentas externas.

Em termos simples: o MCP é uma interface universal entre LLMs e o mundo externo.

Ele define como:

- Um cliente (ex: Claude Desktop, um agente, uma IDE) se comunica com

- Um servidor MCP (ex: um serviço que acessa seu banco de dados, seu sistema de arquivos, uma API)

Essa separação é poderosa. O servidor MCP não sabe — e não precisa saber — qual LLM está do outro lado. E o cliente não precisa saber como o servidor foi implementado.

A arquitetura do MCP

O protocolo é baseado em três conceitos centrais:

Tools (Ferramentas)

São funções que o LLM pode invocar. Exemplos: buscar um registro no banco, enviar um e-mail, executar um script.

Resources (Recursos)

São fontes de dados que o LLM pode ler. Exemplos: um arquivo de texto, um endpoint REST, um documento PDF.

Prompts

São templates de prompt reutilizáveis que o servidor pode expor para o cliente. Útil para padronizar interações complexas.

A comunicação entre cliente e servidor acontece via JSON-RPC 2.0, podendo usar diferentes transportes: stdio (processo local) ou SSE (HTTP, para servidores remotos).

Por que isso é importante?

O MCP resolve um problema clássico de engenharia de software: acoplamento. Antes dele, sua lógica de integração estava amarrada ao framework ou ao modelo que você escolhia. Com o MCP, você desacopla completamente o como conectar do o que conectar.

Isso traz benefícios concretos:

- ✅ Reusabilidade — Um servidor MCP pode ser usado por qualquer cliente compatível

- ✅ Interoperabilidade — Funciona com Claude, com agentes customizados, com IDEs como Cursor e VS Code

- ✅ Ecossistema crescente — Empresas como Cloudflare, Stripe, GitHub e Notion já publicaram servidores MCP oficiais

- ✅ Padronização — Menos reinvenção de roda, mais foco no que realmente importa

MCP na prática: onde ele já está sendo usado?

Hoje, o MCP já é suportado nativamente por:

- Claude Desktop (Anthropic)

- Cursor e Windsurf (IDEs com IA)

- VS Code (via extensões)

- Amazon Bedrock e Google Gemini (suporte em expansão)

E o número de servidores MCP públicos cresce diariamente. Existe até um repositório comunitário chamado mcp.so que cataloga centenas deles.

O MCP não é apenas mais um padrão técnico. Ele representa uma mudança de paradigma na forma como construímos sistemas com IA: saindo de integrações frágeis e acopladas para uma arquitetura modular, interoperável e escalável.

Se você quer construir agentes de IA sérios — seja para uso pessoal, para sua empresa ou para o mercado — entender o MCP é essencial.

No próximo post, vamos conhecer o FastMCP, a biblioteca Python que torna a criação de servidores MCP algo surpreendentemente simples e elegante.

Gostou do post? Deixa um comentário e volta no blog nos próximos dias para ler os próximos post da série!

[…] post anterior, entendemos o que é o Model Context Protocol e por que ele está se tornando o padrão da […]

[…] 1: O que é MCP e por que ele importa para o futuro dos agentes de IA?Post 2: FastMCP: a forma mais rápida de criar servidores MCP em […]